Rapport sur l’usage de l’intelligence artificielle à des fins thérapeutiques chez les étudiants

Introduction

Peut-on se confier à un algorithme ? Alors que la santé mentale des étudiants est devenue un enjeu majeur de notre société, de nouveaux interlocuteurs font leur apparition sur nos écrans : les intelligences artificielles. Imaginons un étudiant en période d’examen au milieu de la nuit qui ne parvient pas à dormir à cause de ses inquiétudes académiques. L’étudiant est stressé à cause des examens qui approchent. Face à l'impossibilité de contacter un professionnel ou un proche pour partager ses inquiétudes, il prend son téléphone portable et il commence à discuter avec une application d'intelligence artificielle. Les étudiants universitaires utilisent maintenant les outils d’intelligence artificielle ( IA) qui sont un “ensemble des théories et des techniques mises en œuvre pour réaliser des machines dont le fonctionnement s’apparente à celui du cerveau humain” (Larousse, 2024). Ils les utilisent afin de partager leurs sentiments, leurs inquiétudes et pour exprimer leurs difficultés. Dans ce contexte, on voit émerger une forme d'intelligence artificielle à mémoire limitée : “utile dans les tâches qui nécessitent une certaine connaissance du contexte, elle inclut l'IA générative qui exploite des données pour apprendre des schémas et générer de nouvelles réponses” (Box, 2024). Cependant, nous considérons l'utilisation de l'intelligence artificielle comme un « soutien psychologique » non pas comme un traitement clinique à proprement parler, mais comme un soutien auquel les élèves ont recours pour gérer leur stress et pour un apaisement immédiat. Dans cette étude, nous cherchons à comprendre si les étudiants considèrent les outils d'intelligence artificielle comme un “confident” en qui ils peuvent vraiment avoir confiance, ou s'ils les perçoivent simplement comme un logiciel, c'est-à-dire comme un outil complémentaire.

Après avoir défini les concepts clés, notre question de départ devient : Entre simple curiosité et nouveau recours thérapeutique, où se situent les étudiants face à ces outils ? Cette question de départ nous a amenés à définir la problématique principale de notre étude :

“ Quelles sont les motivations et les perceptions des étudiants qui utilisent l'intelligence artificielle comme ressource de soutien psychologique ?”.

Suite à ce questionnement, nous avons mené notre enquête dans un contexte universitaire marqué par l’évolution rapide des outils d’intelligence artificielle dans la vie quotidienne des étudiants. Elle porte sur une population spécifique : des étudiants universitaires utilisant ces outils non seulement à des fins académiques, mais aussi pour répondre à des besoins personnels liés au bien-être, au soutien ou à la recherche de conseils.

Le terrain de l’enquête est principalement numérique, à travers la diffusion d’un questionnaire en ligne, complété par quelques passations en face à face au sein d’espaces universitaires (résidences étudiantes et lieux communs). Le phénomène étudié concerne donc les usages de l’intelligence artificielle dans la vie quotidienne des étudiants, ainsi que les pratiques et logiques sociales qui y sont associées.

État de l’art :

L'un des thèmes centraux de notre analyse porte sur les raisons qui poussent les étudiants universitaires à utiliser des outils d'intelligence artificielle pour obtenir un soutien thérapeutique. Pour comprendre ces pratiques d'utilisation, nous pouvons nous appuyer sur l'ouvrage de Pierre Bourdieu intitulé La distinction . Nous pouvons nous concentrer sur les formes de capital que les étudiants possèdent. Pour Bourdieu, les choix des individus ne sont pas libres, au contraire chaque choix qu'ils font est en réalité déterminé par le capital économique et culturel. Dans ce contexte, il existe une différence entre les étudiants possédant un haut capital économique et ceux qui ont un capital économique plus faible. Cela reflète leurs motivations à utiliser l’intelligence artificielle. Le coût élevé des services de santé professionnels, pousse les étudiants à faible capital économique à s’orienter vers les outils d’intelligence artificielle gratuits. Par conséquent, cette utilisation devient pour eux un « goût de nécessité » qui se caractérise par l’intériorisation inconsciente des contraintes économiques. Alors que les étudiants disposant d’un capital économique élevé ont accès à une aide professionnelle, ils utilisent l’intelligence artificielle pour obtenir une réponse rapide ou considèrent ces outils comme un outil complémentaire.

Pour comparer notre analyse à une perspective plus moderne, nous pouvons nous appuyer sur les concepts de solitude numérique et de liens technologiques évoqués par Sherry Turkle dans son ouvrage intitulé Seuls ensemble : De plus en plus de technologies , de moins en moins de relations humaines. Turkle examine les effets de la technologie sur l’affectivité humaine. Selon Turkle, les machines ne sont plus seulement des outils. Comme l’écrit l’auteure, « La technologie nous charme lorsque ce qu’elle a à nous offrir parle à notre fragilité humaine » (p. 19). Turkle soutient que les individus peuvent se cacher dans les environnements numériques pour échapper au sentiment d’être jugés et interrogés qu’ils pourraient ressentir dans leurs relations réelles avec d’autres personnes. La raison principale est que les outils numériques offrent une possibilité d’anonymat. Dans ce contexte, les élèves peuvent considérer les outils d’intelligence artificielle, toujours prêts à les écouter, comme des confidents et exprimer ouvertement leurs sentiments à ces outils. Contrairement à une thérapie avec un vrai professionnel de la santé, le fait de pouvoir mettre fin à la communication à tout moment ou d'interrompre l'IA lorsqu'ils s'adressent à elle leur garantit un contrôle total sur le processus.

Dans son ouvrage intitulé Le robot : ceci n'est pas un humain ! , Serge Tisseron examine les raisons pour lesquelles les individus peuvent facilement faire confiance à l'intelligence artificielle et aux robots. Selon lui, les fabricants de systèmes d'intelligence artificielle créent une illusion d'empathie pour rassurer les utilisateurs et masquer la réalité de la machine. Ainsi, les individus, oubliant que ces outils ne sont qu'un logiciel, partagent avec l'intelligence artificielle des sentiments intimes et sensibles qu'ils hésiteraient à confier à d'autres personnes. L'intelligence artificielle imite les émotions et l'empathie humaines. De plus, Tisseron souligne que l’usage des technologies a rendu les individus moins tolérants à l'attente, les poussant à préférer l'accessibilité immédiate de l'intelligence artificielle à la lenteur de l'aide professionnelle.

Hypothèses

Pour répondre à notre problématique, nous formulons six hypothèses principales :

-

Hypothèse 1 : La motivation de l’accessibilité

L'IA compense les défauts du système de soin : là où la médecine traditionnelle demande du temps et de l'argent, l'IA offre une réponse immédiate et sans frais. Les étudiants se tournent vers l'IA non pas parce qu'elle est "meilleure" qu'un psychologue, mais parce qu'elle est disponible n’importe quand et qu'elle ne coûte rien, contrairement à une consultation privée.

Les étudiants préfèrent l'intelligence artificielle aux services de santé professionnels pour différentes raisons, notamment la difficulté à obtenir un rendez-vous ou la longueur des procédures de prise de rendez-vous. Les individus ont recours aux outils d'intelligence artificielle pour obtenir un apaisement immédiat, surtout lorsque les établissements de santé sont fermés ou inaccessibles. Pour prouver cela, nous pouvons nous appuyer sur le moment de la connexion (nuit/week-end), le temps d'attente estimé pour un rendez-vous physique ou encore le budget de l'étudiant.

-

Hypothèse 2 : La perception de l’anonymat

L’absence de regard humain et de jugement de l’IA favorise la confidence sur des sujets stigmatisés ou tabous.

Il est parfois plus facile de dire que l’on va mal à un robot qu'à un humain par peur d'être jugé ou de paraître faible. L'IA est perçue comme un "journal intime" plutôt que comme un recours médical.

Nous pouvons nous appuyer sur le niveau d'aisance à parler de sujets tabous à l'IA plutôt qu’à un humain, le sentiment de sécurité des données ou la crainte du jugement par les professionnels de santé.

-

Hypothèse 3 : La perception de l’outil

L’intelligence artificielle n’est pas perçue comme un remplacement au thérapeute, mais comme un outil de premier recours pour la gestion du stress quotidien et des émotions.

Les étudiants font la distinction. Ils utilisent l'IA pour "évacuer" le stress des examens par exemple mais considèrent toujours l'humain nécessaire pour des pathologies plus lourdes (dépression, trauma).

Nous pouvons nous appuyer sur le type de problèmes abordés avec l'IA (stress, organisation, solitude) et l'intention de consulter un vrai professionnel à l'avenir.

-

Hypothèse 4 : Le "Capital Santé" et la gestion autonome du bien être par l’IA

Plus le capital culturel et le niveau d’information sur la santé mentale sont élevés, plus l’IA est utilisée comme un outil complémentaire plutôt que comme un outil de réconfort ou de soutien affectif.

En sociologie, on étudie souvent comment les classes sociales s'approprient les outils. Nous supposons que les étudiants disposant d'un capital culturel plus élevé et « mieux informés » sur la santé mentale utilisent les outils d'intelligence artificielle comme un guide technique pour développer des stratégies de gestion des émotions, tandis que ceux dont le capital culturel est plus faible y cherchent un réconfort face à leurs émotions.

Nous pouvons nous appuyer sur le niveau d’information sur la santé mentale,le capital culturel des étudiants, la catégorie socio-professionnel des parents et l’apprentissage de ces nouvelles techniques.

-

Hypothèse 5 : Le "Contrôle" sur la thérapie

L'étudiant utilise l'IA pour rester maître de la situation. Il préfère gérer son propre suivi plutôt que de se sentir en position d'infériorité face à un psychologue.

Certains étudiants préfèrent l'IA non pas par défaut, mais parce qu'ils ne veulent pas être en position de "patient" face à un professionnel (le psychologue).

Nous pouvons étudier le sentiment de contrôle que les étudiants ressentent avec l’IA en comparaison avec le psychologue et le renoncement à une consultation avec un professionnel.

-

Hypothèse 6 : Le genre et l'anonymat émotionnel

Les étudiants masculins, qui consultent moins de psychologue par crainte d'avoir l'air faibles, utilisent l'IA car c'est un outil qui leur permet de parler de leurs émotions sans avoir l'impression de perdre leur dignité.

Les hommes, par pudeur ou par peur de perdre leur dignité, cachent plus leur mal être émotionnel et consultent alors moins de professionnelles de santé mentale. Ils se confieraient alors plus facilement à l’ia qui ne porte aucun jugement .

Nous pouvons nous appuyer sur le genre des étudiants, à ce qu'ils diraient plus à une IA plutôt qu'à un humain et si ils ont déjà consulté un professionnel de santé mentale.

Méthodologie

Notre analyse repose sur un questionnaire que nous avons élaboré en ligne et qui comprend 28 questions principales, ainsi que des sous-questions, pour un total de 34 questions donc 34 variables étudiées. Le temps nécessaire pour répondre au questionnaire varie d'une personne à l'autre, mais il prend environ 10 à 15 minutes. Notre échantillon est constitué d'étudiants universitaires qui utilisent des outils d'intelligence artificielle pour répondre à leurs besoins personnels, notamment en matière de bien-être, de soutien ou de conseil.

Afin de toucher le plus grand nombre de personnes possible, nous avons d'abord envoyé le lien vers le questionnaire à notre propre entourage et nous avons demandé de le diffuser à leur tour. Nous avons aussi contacté des personnes via les réseaux sociaux. Nous avons également envoyé le lien au secrétariat de notre licence et lui avons demandé de le transmettre aux autres étudiants afin que davantage de personnes répondent à notre enquête. De plus, nous avons partagé notre questionnaire en face à face à un total de 4 participants. Pour cela, nous avons attendu à l’entrée des résidences universitaires et dans les espaces communs de l’université pour demander aux personnes de répondre à notre questionnaire.

Finalement, nous avons recueilli les réponses de 58 participants sur le site web et de 4 personnes interrogées en face à face, soit un total de 62 participants. Nous avons procédé au nettoyage de cet ensemble de données et au codage de ses variables sur Google Sheets. Nous avons identifié les réponses manquantes en remplaçant les champs vides par la mention « N/A ». Nous avons également créé les tableaux et les graphiques destinés à tester nos hypothèses sur Google Sheets. Par ailleurs, nous avons utilisé les graphiques du site web de Fabien Torre qui est notre professeur du cours « Enquêtes sur le web », dans notre analyse pour vérifier la validité de nos hypothèses.

Nous avons rencontré certaines limites et difficultés au cours du processus d'enquête. L'une des principales limites est que 79,31 % des étudiants ayant répondu à notre enquête étaient des femmes. Ce déséquilibre entre les taux de réponse des femmes et des hommes crée un biais de représentativité. En raison de ce déséquilibre, nous avons décidé que nous ne pouvions pas analyser de manière fiable notre hypothèse 6, qui reposait principalement sur la comparaison de l’utilisation de l’IA selon le genre, car les données dont nous disposons ne sont pas suffisantes pour analyser les pratiques des hommes. Nous avons donc décidé de ne pas prendre cette hypothèse en compte dans notre analyse. Les publications que nous avons faites sur les réseaux sociaux pour inciter les gens à participer à notre enquête, ainsi que le fait que notre entourage compte un grand nombre de femmes, ont peut-être contribué à ce que la grande majorité des participants à notre enquête soient des femmes.

Une autre difficulté concerne les enquêtes menées en face à face. Lors des entretiens en face à face que nous avons menés, les étudiants, toujours pressés, n'ont pas pris le temps de réfléchir aux questions comme ils l'auraient fait en ligne et ont souhaité terminer l'entretien au plus vite. Nous avons posé les questions à voix haute aux participants et avons noté nous-mêmes leurs réponses sur les questionnaires que nous avions en main.

De manière générale, la compréhension des questions n'a pas posé de problème. Toutefois, lorsque nos participants ont eu du mal à comprendre certaines questions ou modalités de réponse nous avons reformulé la question pour la rendre plus facile à comprendre. Tout en reformulant les questions, nous avons pris soin de ne pas les orienter vers un choix particulier.

En conclusion, bien que nous ayons pris soin de préserver notre neutralité, le fait de lire les questions à voix haute et de reformuler certaines d'entre elles a pu influencer les réponses des participants. En particulier, le fait que les étudiants, à l'entrée ou à la sortie de l'université, aient dû s'arrêter pour répondre à notre enquête alors qu'ils se dépêchent de rentrer chez eux a peut-être empêché les participants de réfléchir de manière aussi approfondie qu'ils l'auraient fait sur Internet.

Présentation de l'échantillon

Notre échantillon est composé de 62 étudiants ayant répondu à notre questionnaire. L’analyse des caractéristiques sociodémographiques permet de mieux comprendre la structure de notre population enquêtée.

Tout d’abord, la répartition selon le genre montre un fort déséquilibre. En effet, les femmes représentent une large majorité des répondants, avec 79,31 %, contre 17,24 % d’hommes et une très faible part de personnes non-binaires (environ 3,45 %). Ce déséquilibre constitue une limite importante de notre enquête. En raison de cette surreprésentation féminine, nous ne pouvons pas analyser de manière fiable l’hypothèse 6, qui porte sur les différences de comportement entre les hommes et les femmes dans l’usage de l’IA pour exprimer leurs émotions. Le faible nombre d’hommes dans l’échantillon ne permet pas de produire des résultats comparatifs solides.

Ensuite, concernant l’âge des répondants, mesuré à partir de l’année de naissance, on observe une concentration autour des années 2004 et 2005, avec un pic particulièrement marqué en 2005 autour de laquelle les effectifs décroissent progressivement. Cela indique que notre échantillon est majoritairement composé de jeunes étudiants surement en licence maximum, ce qui est cohérent avec une population universitaire. Nous pouvons aussi dire que ces résultats sont potentiellement biaisé par l’âge de notre entourage auquel nous avons partagé notre questionnaire.

Enfin, la répartition selon le niveau d’études montre que les étudiants de 1ère et 2ème année représentent 53,45 % de l’échantillon, tandis que ceux de 3ème année représentent 39.65 %, et ceux de 4ème et 5ème année seulement 6,9 %. Les deux premières catégories étant relativement proches en effectif, nous avons fait le choix de ne pas distinguer les analyses selon l’année d’étude. Cette homogénéité permet de considérer l’échantillon comme globalement comparable sur ce critère.

On peut alors dire que notre échantillon est principalement composé de jeunes étudiantes en début de cursus universitaire, ce qui doit être pris en compte dans l’interprétation des résultats.

Plan

À partir de cette présentation de l’échantillon, il est désormais possible d’analyser plus précisément les résultats de notre enquête afin de répondre à notre problématique : quelles sont les motivations et les perceptions des étudiants qui utilisent l’intelligence artificielle comme ressource de soutien psychologique ? Pour cela, notre analyse s’organise en trois grandes parties, chacune correspondant à un axe central de compréhension du phénomène.

Dans un premier temps, nous nous intéresserons aux motivations d’usage de l’intelligence artificielle, en montrant en quoi celle-ci constitue une réponse accessible et immédiate au mal-être étudiant. Il s’agira notamment de mettre en évidence le rôle de l’accessibilité (coût, rapidité, disponibilité) ainsi que celui de l’expression émotionnelle facilitée par l’absence de jugement.

Dans un second temps, nous analyserons les perceptions de l’IA, en montrant qu’elle est avant tout considérée comme un outil de gestion émotionnelle sous contrôle. Nous verrons qu’elle est perçue comme complémentaire aux professionnels de santé, et qu’elle permet aux étudiants de garder une certaine maîtrise de la relation.

Enfin, dans une troisième partie, nous mettrons en évidence le fait que ces usages et ces perceptions sont socialement différenciés, en mobilisant les notions de capital économique et de capital culturel. Cette partie permettra de montrer que le recours à l’IA et les manières de l’utiliser varient selon les ressources sociales des étudiants, notamment leur niveau d’information en santé mentale et leur origine sociale.

Analyse des résultats

I. Les motivations d’usage de l’intelligence artificielle : une réponse accessible et émotionnelle au mal-être étudiant

1. Une accessibilité déterminante dans le recours à l’IA

L’analyse du tableau « Consultation chez un professionnel selon les ressources mensuelles des étudiants » met en évidence des inégalités significatives dans l’accès aux soins psychologiques. Les étudiants disposant de moins de 400€ par mois sont les plus nombreux à ne jamais avoir consulté un professionnel avec 8 personnes sur les 54 ayant répondu à cette question , tandis que ceux ayant plus de 1000€ sont les plus nombreux à avoir consulté un professionnel soit par le passé ( 8 sur 54) soit actuellement ( 7 sur 54). On remarque aussi que ceux qui disposent d’entre 400 et 1000€ sont les deuxième plus nombreux à avoir déjà consulté un professionnel derrière ceux qui ont plus de 1000€ par mois avec 6 personnes sur 54. Ces résultats montrent que l’accès aux professionnels de santé reste fortement dépendant des ressources économiques. On peut tout de même dire que 11 personnes n’ont pas voulu préciser leur revenus mensuel donc nous ne pouvons pas les prendre en compte dans ce tableau.

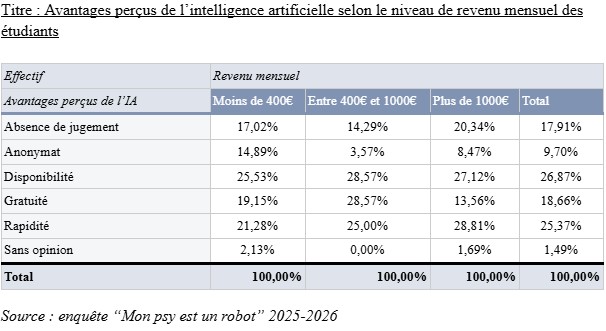

Cette contrainte se retrouve dans le tableau « Avantages perçus de l’intelligence artificielle selon le niveau de revenu mensuel des étudiants » , où la disponibilité, la rapidité et la gratuité apparaissent comme des critères centraux dans le recours à l’IA avec respectivement 26,87% de personnes qui voit la disponibilité comme l’avantage principal de l’IA , 25,37% pour la rapidité et 18.66% pour la gratuité. Ces caractéristiques permettent aux étudiants de contourner les contraintes du système de soins, notamment le coût et les délais d’attente.

On remarque aussi dans ce tableau que pour les personnes ayant moins de 400€ par mois , l’avantage principal de l’IA pour eux est la disponibilité avec 25,53%. Pour les personnes qui ont entre 400 et 1000€ , c’est la disponibilité et la gratuité avec 28,57% qui est le plus choisi et enfin pour les personnes ayant plus de 1000€ par mois l’avantage le plus important est la rapidité avec 28,81%.

Ces résultats montrent que la disponibilité de l’intelligence artificielle constitue un avantage central pour les étudiants aux revenus les plus faibles, tandis que ceux ayant des revenus intermédiaires valorisent à la fois la disponibilité et la gratuité (28,57 %), ce qui souligne l’importance des contraintes économiques. En revanche, les étudiants ayant plus de 1000€ mettent davantage en avant la rapidité (28,81 %), traduisant une logique d’optimisation du temps plutôt que de contrainte financière. Ainsi, si l’IA est globalement utilisée pour son accessibilité, les raisons précises varient selon le niveau de ressources.

Ces résultats confirment que l’IA constitue une réponse aux contraintes du système de soins. Elle est mobilisée pour son accessibilité, sa rapidité et son faible coût. Ce qui valide donc notre première hypothèse selon laquelle les étudiants ont recours à l’intelligence artificielle principalement pour compenser les limites d’accès aux professionnels de santé.

Cette dynamique peut être interprétée à travers le concept de “goût de nécessité” (Bourdieu) : les individus adaptent leurs pratiques en fonction de leurs contraintes économiques. On peut également mobiliser la Zweckrationalität qui est l’action rationnelle en finalité (Weber), qui souligne que les individus choisissent les moyens les plus efficaces pour atteindre leurs objectifs. L’accessibilité apparaît comme une motivation centrale dans l’usage de l’intelligence artificielle comme ressource de soutien psychologique.

2. Un espace d’expression facilité par l’absence de jugement

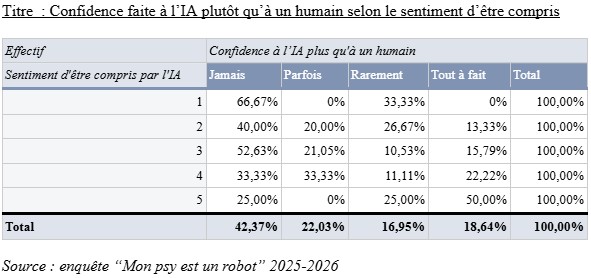

L’analyse du tableau « Confidence faite à l’IA plutôt qu’à un humain selon le sentiment d’être compris » montre que plus les étudiants se sentent compris par l’IA (c’est-à-dire lorsque le score se rapproche de 5), plus ils ont tendance à lui accorder leur confiance en se confiant plus à elle qu'à un humain. En effet, parmi ceux qui déclarent se sentir fortement compris par l’IA (“5”), 50 % affirment se confier “Tout à fait” plus à l’IA qu'à un humain.

À l’inverse, les étudiants qui déclarent ne jamais ou rarement se confier à l’IA plus qu'à un humain sont plus nombreux à avoir un faible sentiment de compréhension (scores proches de 1 ou 2). Par exemple, parmi ceux qui se confient “ Jamais” à l’IA plus qu'à un humain, 66,67 % déclarent un sentiment d’être compris par l’IA très faible (“1”).

Cela montre donc une relation claire : le sentiment d’être compris par l’IA favorise la confiance en l’IA plutôt qu'à un humain.

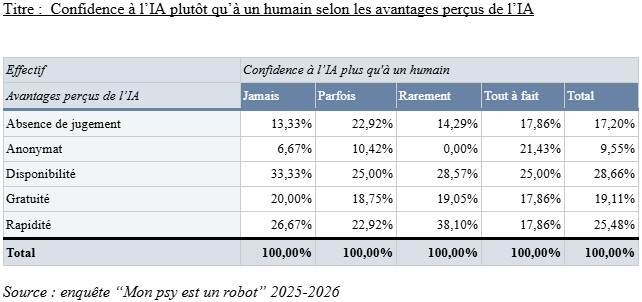

Le tableau « Confidence à l’IA plutôt qu’à un humain selon les avantages perçus de l’IA » met en évidence que, parmi les étudiants qui déclarent se confier « tout à fait » à l’IA plutôt qu’à un humain , certains avantages sont particulièrement valorisés. C’est notamment le cas de l’anonymat (21,43 %) et de la disponibilité (25 %), qui apparaissent comme des éléments centraux dans leur recours à l’IA.

Cela signifie que les étudiants qui se confient le plus à l’IA sont ceux qui recherchent un espace accessible à tout moment, mais aussi protégé du regard d’autrui. L’anonymat permet de s’exprimer sans crainte du jugement, tandis que la disponibilité garantit une réponse immédiate, ce qui favorise la confidence.

Ces résultats permettent de valider globalement l’hypothèse 2, selon laquelle l’absence de regard humain et de jugement favorise la confidence à l’IA. En effet, le fait de se sentir compris par l’intelligence artificielle apparaît comme un facteur déterminant dans le fait de s’y confier davantage, ce qui confirme que l’IA peut constituer un espace d’expression sécurisé, notamment pour aborder des sujets sensibles ou tabous sans crainte d’être jugé. Par ailleurs, l’importance accordée à l’anonymat et à la disponibilité renforce cette idée d’un espace accessible et protégé, proche d’un « journal intime ».

Toutefois, ces résultats peuvent être nuancés : l’ensemble des étudiants ne se confie pas davantage à l’IA, ce qui montre que, malgré ces avantages, le recours à l’IA reste partiel et dépend du ressenti individuel, notamment du degré de compréhension perçu.

Ces résultats rejoignent les travaux de Sherry Turkle, qui montre que les technologies numériques offrent un espace d’expression protégé, permettant aux individus de se livrer plus facilement. L’IA peut ainsi être assimilée à un “journal intime numérique”.

L’IA est perçue comme un espace émotionnel sécurisé, ce qui constitue une motivation importante dans son usage.

II. Les perceptions de l’IA : un outil de gestion émotionnelle sous contrôle

1. L’IA comme outil complémentaire et non substitut au psychologue

Le graphique « L’apprentissage d’outils grâce à l’IA à but thérapeutique » montre que les usages de l’IA sont variés : pour 38,18 % des étudiants, l'IA leur a permis de comprendre leurs symptômes, tandis que pour 25,45 % ils recherchent juste un réconfort émotionnel. Une très faible part des étudiants ont appris des exercices précis grâce à l’IA ( 7,28%) , de plus on remarque que beaucoup n’ont pas du tout appris de nouveaux outils grâce à cet usage (29,09%).

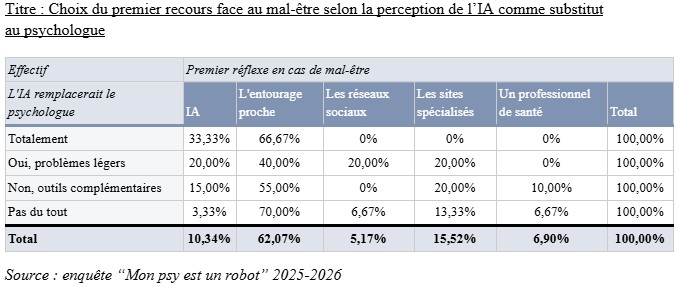

Le tableau « Choix du premier recours face au mal-être selon la perception de l’IA comme substitut au psychologue » montre que l’intelligence artificielle ne constitue pas le premier réflexe des étudiants en situation de mal-être. En effet, 62,07 % se tournent d’abord vers leur entourage proche, contre seulement 10,34 % vers l’IA, ce qui confirme le rôle central des relations sociales.

Cependant, une différence apparaît selon le type de recours. Parmi les étudiants qui considèrent que l’IA remplacerait “totalement” le psychologue, 33,33 % se tournent en premier lieu vers l’IA, mais aussi 66,67 % vers leur entourage proche. À l’inverse, ceux qui estiment que l’IA est seulement utile pour des problèmes légers ou constitue un outil complémentaire se tournent davantage vers des ressources diversifiées, comme les réseaux sociaux (20 %), les sites spécialisés (20 %) ou encore, dans une moindre mesure, les professionnels de santé (10 %).

Ces résultats montrent que la perception de l’IA influence les pratiques de recours : plus les étudiants attribuent à l’IA un rôle central, plus ils sont susceptibles de s’y référer directement. Néanmoins, même dans ce cas, l’entourage reste majoritairement privilégié.

Ces résultats permettent de valider l’hypothèse 3, selon laquelle l’IA est perçue comme un outil complémentaire plutôt que comme un véritable substitut au psychologue. Elle peut constituer un recours ponctuel, mais ne remplace pas les relations humaines, qui demeurent centrales dans la gestion du mal-être.

Ces résultats montrent que les étudiants ne se tournent pas vers une seule forme d’aide, mais mobilisent différentes ressources selon les situations, comme leur entourage, les professionnels de santé ou encore les outils numériques.

L’IA est alors perçue comme un outil utile mais limité, intégré dans un ensemble plus large de pratiques de gestion du mal-être.

2. Une relation thérapeutique maîtrisée par l’étudiant

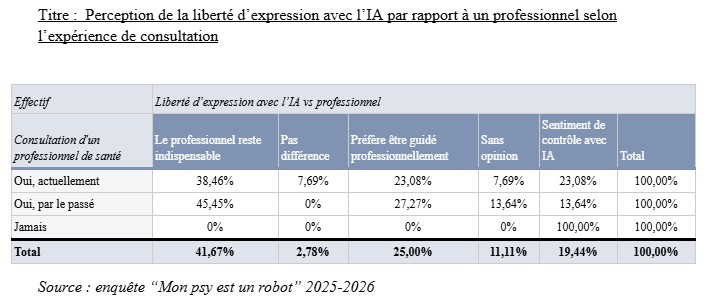

Le tableau « Perception de la liberté d’expression avec l’IA par rapport à un professionnel selon l’expérience de consultation » montre que le rapport à l’IA varie fortement selon l’expérience des étudiants avec les professionnels de santé. En effet, les étudiants n’ayant jamais consulté sont 100 % à déclarer ressentir un sentiment de contrôle avec l’IA, ce qui indique qu’ils privilégient une relation où ils maîtrisent entièrement l’échange.

À l’inverse, parmi les étudiants ayant déjà consulté, une majorité considère que le professionnel reste indispensable (45,45 %), et cette tendance est également présente chez ceux qui consultent actuellement (38,46 %). Ces derniers valorisent davantage l’accompagnement et l’expertise du professionnel, même si une part non négligeable reconnaît aussi un certain contrôle avec l’IA (23,08 % chez ceux qui consultent actuellement).

Ces résultats montrent que l’expérience du suivi psychologique influence les perceptions : plus les étudiants ont été confrontés à un professionnel, plus ils reconnaissent la valeur de son expertise, tandis que ceux qui n’ont jamais consulté privilégient l’autonomie offerte par l’IA.

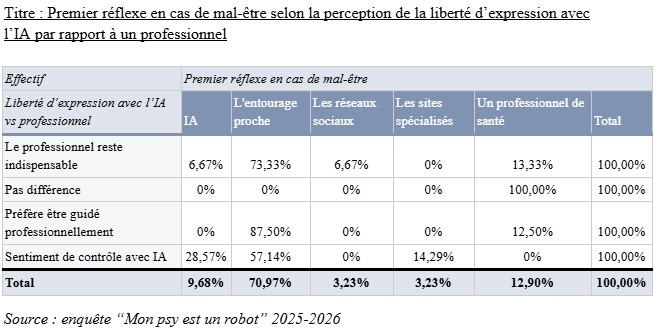

Le tableau « Premier réflexe en cas de mal-être selon la perception de la liberté d’expression avec l’IA par rapport à un professionnel » montre que les étudiants valorisant le sentiment de contrôle avec l’IA sont plus susceptibles de se tourner vers elle : 28,57 % d’entre eux déclarent l’IA comme premier recours, ce qui est nettement supérieur à la moyenne globale (9,68 %). Cela confirme que la perception de contrôle favorise le recours à l’IA.

Cependant, quel que soit le rapport à l’IA, l’entourage proche reste le premier recours majoritaire (70,97 %). Par exemple, même parmi ceux qui ressentent un contrôle avec l’IA, 57,14 % se tournent d’abord vers leur entourage.

Par ailleurs, on observe que les étudiants qui considèrent que le professionnel reste indispensable ou qui préfèrent être guidés se tournent, après l’entourage proche , vers des formes de soutien plus institutionnelles en second recours, avec respectivement 13,33 % et 12,5 % qui déclarent consulter un professionnel.

Ces résultats montrent que le rapport à l’IA structure les pratiques de recours : le sentiment de contrôle favorise l’usage de l’IA, tandis que la confiance dans l’expertise professionnelle oriente vers les professionnels de santé.

Ces résultats permettent de valider l’hypothèse 5, selon laquelle l’IA est utilisée pour garder le contrôle sur la relation thérapeutique. En effet, les étudiants n’ayant jamais consulté sont 100 % à déclarer un sentiment de contrôle avec l’IA, et ceux qui valorisent ce contrôle avec l’IA y ont davantage recours (28,57 % contre 9,68 % en moyenne).

Cependant, cette hypothèse doit être nuancée, car l’entourage reste le premier recours majoritaire (70,97 %), et les étudiants ayant déjà consulté reconnaissent davantage l’importance du professionnel (45,45 % et 38,46 %).

Ces résultats s’inscrivent dans un processus d’individualisation (Beck), où les individus cherchent à gérer eux-mêmes leur bien-être. Toutefois, le rôle central de l’entourage montre que cette autonomie reste fortement liée aux relations sociales.

Ces résultats montrent que les étudiants utilisent l’IA pour le contrôle qu’elle offre, mais qu’ils continuent de privilégier l’entourage et les professionnels, ce qui éclaire à la fois leurs motivations et leurs perceptions de cet outil.

III. Des usages socialement différenciés : le rôle du capital culturel

1. L’influence du capital économique

Comme nous l’avons déjà montré à partir du graphique « Consultation chez un professionnel selon les ressources mensuelles des étudiants » , le recours aux professionnels de santé est socialement différencié.

Dans cette partie, ces résultats peuvent être réinterprétés à travers le rôle du capital économique. En effet, les étudiants disposant de ressources plus élevées ont davantage accès aux consultations, tandis que ceux ayant peu de ressources y recourent moins. Cette inégalité d’accès ne renvoie pas seulement à un comportement individuel, mais à des contraintes matérielles qui structurent les pratiques.

Ainsi, pour les étudiants les moins favorisés, l’intelligence artificielle apparaît comme une alternative accessible, car gratuite et disponible, contrairement aux consultations professionnelles souvent coûteuses. À l’inverse, les étudiants disposant de plus de ressources peuvent davantage s’inscrire dans un recours classique au système de soins.

Ces résultats confirment que les usages de l’IA s’inscrivent dans des logiques socialement différenciées : le recours à l’IA peut relever d’un usage contraint, lié au manque de capital économique. Cela rejoint l’analyse de Bourdieu, selon laquelle les pratiques sont conditionnées par les ressources disponibles et peuvent relever d’un « goût de nécessité ».

2. Le rôle du capital culturel dans les usages de l’IA

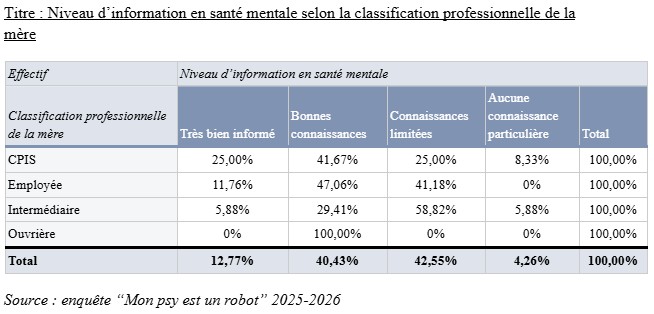

Le tableau “Niveau d’information en santé mentale selon la classification professionnelle de la mère” permet d’analyser le rôle du capital culturel transmis dans la famille.

On observe que les étudiants issus de milieux favorisés, notamment dont la mère est CPIS (cadre / profession intellectuelle supérieure), sont davantage représentés parmi ceux ayant un bon niveau d’information avec 41,67 % d’étudiants qui ont des « bonnes connaissances » et seulement 25% à avoir des connaissances limitées . À l’inverse, les étudiants dont la mère appartient aux catégories intermédiaires ou employées sont plus nombreux à déclarer des connaissances limitées avec 58,82 % pour les mères avec des professions intermédiaires et 41,18 % pour les mères employées.

Par ailleurs, certaines catégories, comme les ouvrières, présentent un profil plus homogène mais limité, avec 100 % des étudiants déclarant de « bonnes connaissances », ce qui peut s’expliquer par la faiblesse des effectifs car une seule personnes ayant une mère ouvrière a répondu à cette question.

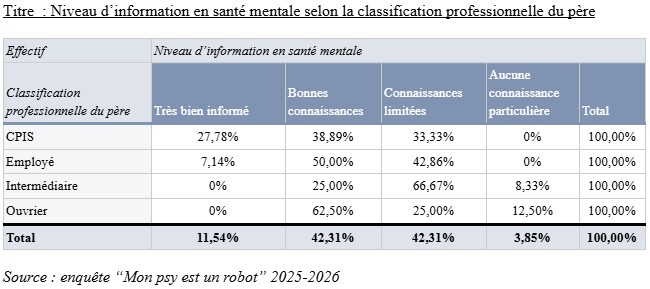

Nous avons également analysé ce même tableau mais pour les pères de étudiants afin d’avoir un point de vue complet sur le rôle du capital culturel transmis dans la famille.

On observe dans ce tableau nommé “ Niveau d’information en santé mentale selon la classification professionnelle du père” que les étudiants dont le père appartient aux catégories favorisées (CPIS) sont davantage représentés parmi les niveaux d’information élevés avec 38,89 % d’étudiants ayant un père étant cadre/profession intellectuelle supérieure qui ont de bonnes connaissances et 33,33% avec des connaissances limitées. À l’inverse, les étudiants issus de milieux plus populaires ou intermédiaires présentent des niveaux d’information limitées plus forts. Par exemple, 66,67 % des étudiants dont le père est de profession intermédiaire déclarent des connaissances limitées.

Les étudiants issus de milieux ouvriers présentent un profil plus contrasté, avec une majorité déclarant de bonnes connaissances (62,50 %), mais aussi une présence plus importante de faibles niveaux d’information avec 12,50 % sans connaissance particulière, ce qui traduit une plus grande hétérogénéité.

L’analyse croisée des tableaux sur sur la classification professionnelle des parents montrent qu’il existe un lien étroit entre l’origine sociale et le niveau d’information en santé mentale. Les étudiants issus de catégories sociales favorisées (CPIS) sont mieux informés sur la santé mentale, tandis que ceux issus des classes moyennes et défavorisées disposent d’informations plus limitées.

Cette analyse est directement liée au concept de capital culturel de Pierre Bourdieu. Le capital culturel transmis par les familles facilite l’accès des élèves à l’information sur la santé mentale. Même si certaines variations existent, notamment en raison de la taille des effectifs, la tendance générale reste claire : l’origine sociale influence l’accès des individus à l’information. Par conséquent, les usages et les perceptions de l’intelligence artificielle sont socialement différenciés. Ainsi, si le niveau d’information en matière de santé mentale dépend en partie de l’origine sociale, il est pertinent de s’interroger sur ses effets concrets sur les pratiques.

3. Des pratiques différenciées face à l’IA selon le niveau d’information

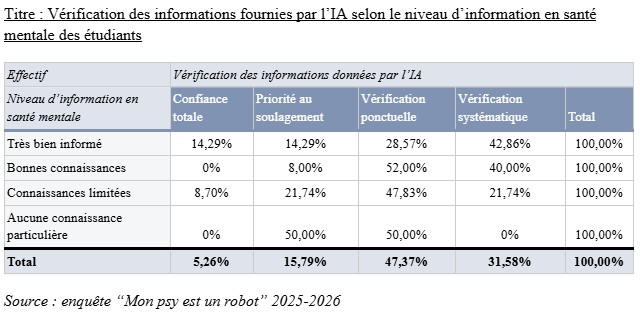

On peut se demander si les étudiants les mieux informés adoptent une posture plus critique face à l’intelligence artificielle. Le tableau suivant, qui met en relation le niveau d’information et la vérification des informations fournies par l’IA, permet précisément d’analyser cette dimension.

En effet dans le tableau “Vérification des informations fournies par l’IA selon le niveau d’information en santé mentale des étudiants” on observe que les étudiants les mieux informés adoptent une attitude plus critique. En effet, parmi les « très bien informés », 42,86 % déclarent vérifier systématiquement les informations et 28,57 % de manière ponctuelle, ce qui traduit une forte capacité à prendre du recul face à l’IA. Cette tendance se retrouve également chez ceux ayant de bonnes connaissances, avec 52 % de vérification ponctuelle et 40 % de vérification systématique.

À l’inverse, les étudiants ayant un faible niveau d’information adoptent des pratiques moins rigoureuses. Ceux ayant des connaissances limitées privilégient davantage la vérification ponctuelle (47,83 %) mais restent moins nombreux à vérifier systématiquement (21,74 %). Enfin, les étudiants n’ayant aucune connaissance particulière se distinguent par une logique différente : 50 % privilégient le soulagement immédiat et 50 % vérifient ponctuellement, sans aucun cas de vérification systématique.

L’ensemble des résultats présentés dans cette partie permet globalement de valider l’hypothèse 4, selon laquelle le capital culturel et le niveau d’information influencent les usages de l’intelligence artificielle. En effet, les analyses montrent que les étudiants issus de milieux socialement favorisés (CPIS), et donc dotés d’un capital culturel plus élevé, disposent en moyenne d’un meilleur niveau d’information en santé mentale et adoptent une posture plus critique face à l’IA, notamment à travers des pratiques de vérification plus fréquentes et systématiques. À l’inverse, les étudiants issus de milieux plus populaires ou intermédiaires présentent davantage de connaissances limitées et ont tendance à utiliser l’IA dans une logique plus immédiate, parfois centrée sur le soulagement plutôt que sur la vérification.

Ces résultats sont en lien avec la perspective de Pierre Bourdieu selon laquelle les dispositions individuelles se façonnent à partir du capital culturel hérité de la famille. Le capital culturel ne détermine pas seulement le niveau de connaissances, il influence également la manière dont les élèves utilisent l’IA : soit comme un outil technique à interroger et à vérifier, soit comme un support de réconfort plus immédiat. On observe ainsi une différenciation sociale des usages, où l’IA ne joue pas le même rôle selon les ressources détenues par les individus.

Enfin, ces résultats montrent que les motivations et les perceptions des étudiants qui utilisent l’IA comme ressource de soutien psychologique ne sont pas homogènes, mais socialement construites. L’IA peut être perçue comme un outil complémentaire mobilisé de manière réflexive mais aussi comme une ressource accessible permettant de remplacer un manque d’informations ou de moyens. Autrement dit, l’usage de l’IA comme soutien psychologique ne dépend pas uniquement des besoins individuels, mais aussi des ressources sociales, économiques et culturelles dont disposent les étudiants.

Conclusion

Les résultats de notre analyse mettent en évidence la motivation et les perceptions des étudiants qui utilisent l'intelligence artificielle comme source de soutien psychologique. Tout d'abord, notre analyse montre que, chez les étudiants universitaires, les pratiques d'utilisation de l'intelligence artificielle à des fins de soutien psychologique et la manière dont elle est perçue dépendent non seulement des besoins individuels, mais aussi des profils sociologiques. Les résultats confirment notre première hypothèse dans un contexte général, en montrant que l'accessibilité et la gratuité de l'IA constituent les principales raisons de son utilisation. Les étudiants utilisent l'IA comme une « compensation » face aux limites du système de santé traditionnel, qui est coûteux et n'est pas toujours accessible. Par ailleurs, en restant anonymes, les étudiants abordent avec les outils d’IA des sujets qu’ils ne pourraient pas confier à un être humain, sans craindre d’être jugés. Nos résultats confirment en ce sens « l’hypothèse 2, selon laquelle l’absence de regard humain et de jugement favorise la confiance envers l’IA ».

Cependant, la principale conclusion de notre analyse est que les modes d'utilisation de l'intelligence artificielle varient en fonction du niveau social. Conformément à notre quatrième hypothèse, nos résultats montrent que le niveau de connaissance des élèves en matière de santé mentale et leur confiance envers l'intelligence artificielle varient en fonction de la catégorie professionnelle de leur famille. Les élèves issus des classes supérieures ont davantage de connaissances en matière de santé mentale et adoptent une approche plus critique vis-à-vis de l'IA. Les élèves issus des classes inférieures, quant à eux, ont des connaissances plus limitées et utilisent l'IA directement pour se rassurer. Bien que l'IA ne puisse se substituer à un professionnel de santé pour ses utilisateurs (hypothèse 3), elle peut constituer un recours ponctuel. Nos résultats montrent que l'utilisation de l'IA leur permet de ressentir un sentiment de contrôle et confirment globalement notre cinquième hypothèse ; il convient toutefois de noter qu'en cas de « mal-être », les étudiants préfèrent, dans un premier temps, s'adresser à leur entourage plutôt que de parler à l'IA.

En somme, les étudiants considèrent l'intelligence artificielle non pas comme un substitut au professionnel de santé, mais comme un « outil complémentaire » face aux contraintes économiques et à la crainte d'être jugés. Les étudiants ont le sentiment de garder le contrôle, et cette manière de l'utiliser varie en fonction du capital social et culturel dont dispose l'étudiant.

Même si les résultats obtenus nous ont permis de confirmer nos hypothèses, il convient de souligner que notre analyse présente de nombreuses limites. Alors que nous avions initialement formulé six hypothèses, le fait que 79,31 % des participants soient des femmes nous a empêchés d'analyser notre sixième hypothèse, qui portait sur les différences entre les pratiques d'utilisation de l'intelligence artificielle chez les femmes et les hommes, car nous ne disposions pas de données suffisantes concernant les hommes. Par ailleurs, bien que nous ayons atteint un total de 62 participants, un échantillon plus large et hétérogène nous aurait permis de recueillir des données plus fiables.

Une autre limite est apparue lors des entretiens menés en face à face. Le fait que nous soyons nous-mêmes étudiants a peut-être empêché les participants de répondre honnêtement à certaines questions par timidité. En particulier, lors des enquêtes menées dans les espaces communs du campus, la précipitation des étudiants pour se rendre quelque part a pu les empêcher de réfléchir suffisamment aux questions et a pu affecter la véracité des réponses.

Enfin, il pourrait être pertinent, dans le cadre de futures recherches, d'étudier l'utilisation de l'intelligence artificielle sous l'angle de l'origine ethnique et du statut de migrant. Outre le facteur de classe sociale sur lequel nous nous sommes concentrés dans notre analyse actuelle, l'origine ethnique peut également influencer les perceptions en matière de santé mentale et la relation établie avec les outils technologiques. On pourrait étudier si les étudiants issus de l'immigration se tournent vers les outils d'IA lorsqu'ils ne peuvent pas bénéficier d'un soutien psychologique dans leur langue maternelle ou lorsqu'ils sont confrontés à une stigmatisation culturelle.

Bibliographie

Beck, U. (2001 [1986]). La société du risque : sur la voie d’une autre modernité. Paris : Flammarion.

Beck, U., & Beck-Gernsheim, E. (2002). Individualization: Institutionalized Individualism and its Social and Political Consequences. London : Sage.

Bourdieu, P. (1979). La distinction : critique sociale du jugement. Paris : Les Éditions de Minuit.

Bourdieu, P. (1980). Le sens pratique. Paris : Les Éditions de Minuit

Box, « Qu'est-ce que l'IA ou l'intelligence artificielle ? », box.com, URL : https://www.box.com/fr-fr/resources/what-is-ai

Éditions Larousse, « Intelligence artificielle », Encyclopédie Larousse en ligne, URL : https://www.larousse.fr/encyclopedie/divers/intelligence_artificielle/187257

Tisseron, S. (2015). Le jour où mon robot m’aimera : vers l’empathie artificielle. Paris : Albin Michel.

Tisseron, S. (2017). Le robot : ceci n'est pas un humain ! Nectart, pp. 118-125.

Turkle, S. (2015). Seuls ensemble : De plus en plus de technologies, de moins en moins de relations humaines (C. Richard, trad.). Paris : L'Échappée.

Weber, M. (1922 [1971 pour la traduction française]). Économie et société. Paris : Plon.